MrC

Registrierter Benutzer

Kollege @Blumi_guitar hatte hier bereits die Moises-App kurz vorgestellt. Ich nutze Moises seit einiger Zeit und möchte die App in dem im Titel genannten Kontext etwas ausführlicher vorstellen.

Kurz zu meinem Hintergrund: ich habe in den 1980er-Jahren mit dem Bassen angefangen, es aber wegen Ausbildung, Studium, Beruf und Familie lange Zeit vernachlässigen müssen. Seit 2014 bin ich wieder regelmäßig am Start und habe seitdem in mehreren Bands gespielt, größtenteils Cover. Zur Notation verwende ich GuitarPro, zum Heraushören Transcribe. Dieses Programm bietet u.a. einen EQ mit Presets, mit denen sich z.B. die Bass-Frequenzen extrem betonen lassen, um die vom Bass gespielten Noten heraushören zu können. Das funktionierte bei mir bei den meisten Titeln so gut, dass ich mir damit von über 300 Songs die Basslinien herausgearbeitet habe. Bei manchen Titeln war’s schwieriger, so dass ich aufmerksam wurde, als mir Moises über den Weg lief, denn über jede Verbesserung des Workflows (oder Beschleunigung des Prozesses) bin ich dankbar. Ich möchte vor allem Bass spielen und nicht nur Bass heraushören.

Nun aber zur App:

Die Entwickler nehmen für sich in Anspruch, vorhandene Musik-Song-Dateien mittels KI in einzelne Instrumenten-Tracks aufteilen zu können, so dass ein Mit-Jammen zum Track (unter Ausblendung des eigenen Instruments) sowie ein genaues Heraushören des einzelnen Instruments zur eigenen Transkription möglich sein soll.

Die App gibt es sowohl für Desktop-PC als auch für Mobilgeräte (Android und Apple). Man kann mit einer Gratisversion starten, es gibt zusätzlich eine Premium- („Voller Zugang für den ernsthaften Musiker“) sowie eine Pro-Version („Fortgeschrittene KI-Tools für die Musikproduktion“), die sich jeweils im Leistungsumfang unterscheiden. So weist die Gratis-Version bereits die Kernfunktionalität (Aufteilen eines Tracks in einzelne Instrumente) auf, jedoch ist dies auf fünf Tracks im Monat beschränkt; außerdem ist die Aufteilung nur in Gesang, Schlagzeug und Bass möglich, weitere Instrumente-Einzel-Tracks für Gitarre, Hintergrundgesang, Klavier und Streicher gibt’s erst ab der Premium-Version, die monatlich 6,99 € oder 50 € im Jahr kostet. Des Weiteren bestehen bei der Gratis-Version Einschränkungen, was die Änderung von Tonhöhe, Tempo etc. angeht, dazu aber im Praxis-Teil mehr. Die recht neue „Pro“-Variante habe ich mir nicht genauer angeschaut; sie kostet 34,99 € im Monat und ist „professioneller“ aufgezogen. Auf der Moises-Webseite gibt es auch einen Vergleich des Funktionsumfangs der jeweiligen Version.

Im Folgenden beschreibe ich die Funktionalität der Gratis-Version anhand eines Beispiels, das ich für mein aktuelles Projekt (Queen-Cover) verwende. Es handelt sich dabei um den Titel „Was It All Worth It“ vom Queen-Album „The Miracle“ aus dem Jahr 1989. Alle Beschreibungen und Screenshots beziehen sich dabei auf die Desktop-PC-Version.

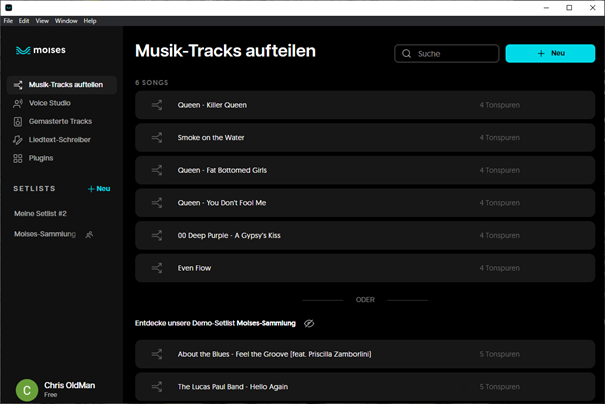

Beim Start des Programms stellt sich die Startseite wie folgt dar:

(Einige der Funktionalitäten in der linken Liste sind den Bezahlt-Versionen vorbehalten)

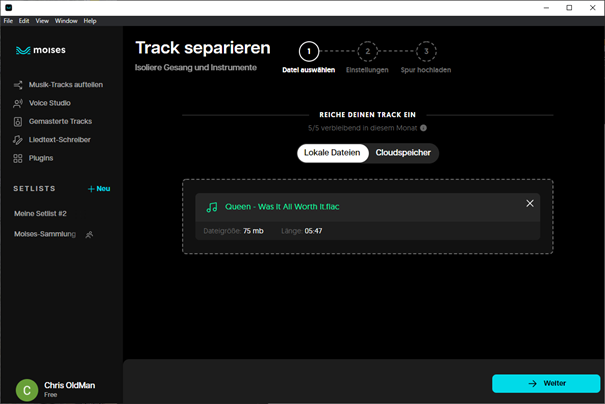

Es erscheint zunächst die Liste der bisher bearbeiteten Tracks. Mit „+ Neu“ wird ein neuer Track hinzugefügt:

Da ich die ganzen Songs auf einer Festplatte habe, kommt eine lokale Datei dazu.

OBACHT: in der Gratis-Version dürfen die Tracks nur maximal fünf Minuten lang sein. Der Rest wird einfach abgeschnitten … im vorliegenden Fall habe ich mir damit geholfen, das fast 40-sekündige Intro des Songs mit einem anderen Programm zu entfernen, zu speichern und neu hochzuladen, dann passte es schon fast.

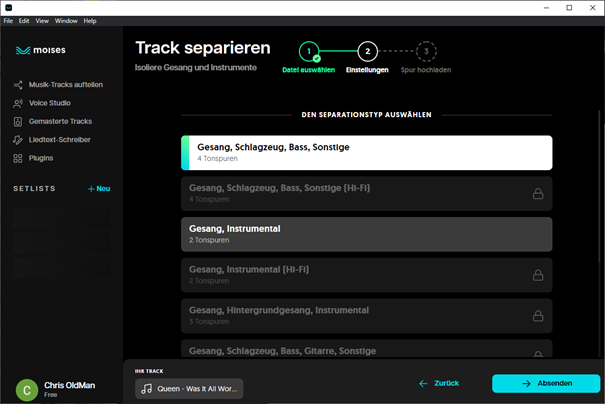

Ist der Track hochgeladen, erscheint die Auswahl, in wie viele Teile der Track gesplittet werden soll:

Auch hier kann man die eingeschränkte Funktionalität der Gratis-Version daran erkennen, dass viele Optionen grau hinterlegt bzw. mit einem Schloss gekennzeichnet sind. Mit „Absenden“ wird der „Auftrag“ erteilt, den Song aufzusplitten:

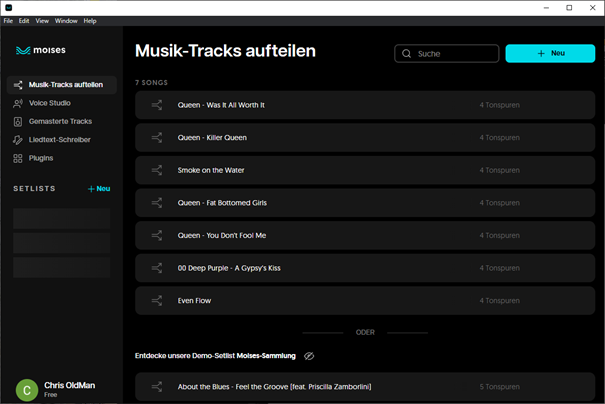

Nach nicht allzu langer Zeit erscheint schließlich das Ergebnis:

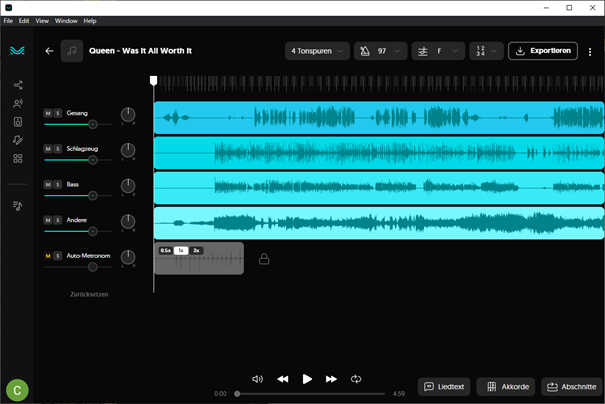

Beim Klick auf den neuen Song dauert die Verarbeitung dann nochmal einige Sekunden, und man hat das Ergebnis des KI-Einsatzes auf dem Bildschirm:

Hier hat man nun u.a. die Möglichkeit, die einzelnen Spuren unterschiedlich laut anzuhören, im Panorama einzuordnen oder auch auf Solo bzw. Mute zu stellen. Die „Auto-Metronom“-Funktion macht genau dies: sie fügt ein Metronom hinzu … wobei mir diese Funktion nicht 100%-ig gefallen hat, bei Songs mit einem synkopierten Rhythmus (Betonung eben NICHT genau auf der EINS) wird’s etwas komisch, was aber durchaus in der Natur der Sache liegt. Von daher macht es mir nichts aus, dass das Metronom in der Gratis-Version nur für eine Minute vorgesehen ist …

Auch die übrigen Funktionen auf diesem Bildschirm sind z.T. nur eingeschränkt verfügbar:

Schaltflächen oben:

Die Schaltflächen unten greifen auf Beta-Versionen zurück und sind in der Gratis-Version nur eingeschränkt nutzbar:

Soweit zur Funktionalität. Bleibt die Frage: funktioniert das Ganze auch tatsächlich? Um die Antwort vorwegzunehmen: in vielen Fällen erstaunlich gut! Klar, es gibt an manchen Stellen Aussetzer, wenn das gewählte Instrument außerhalb seines „normalen“ Frequenzbereiches spielt (wenn z.B der Bass unvermittelt eine Oktave höher spielt) oder „Übersprecher“, wenn sich Gitarre und Gesang frequenz- und soundmäßig sehr nahe beieinander sind, aber im Großen und Ganzen bin ich positiv überrascht, wie sauber – in meinem Fall – das Bass-Signal herausgefiltert wird. Das erleichtert mir die Arbeit des Heraushörens und Transkribierens ein gutes Stück, und genau das war mein Ziel. Bei der Arbeit mit einem EQ (wie bei Transcribe) beispielsweise stehen Bass und Kick bzw. Bass-Drum oft im selben Frequenzbereich in Konkurrenz miteinander, so dass das Heraushören der Bass-Linie alleine öfters schwierig ist.

Im Folgenden noch Hörbeispiele des bearbeiteten Songs (der Ausschnitt enthält jeweils 2. Intro, 1. Strophe, 1. Refrain):

1. Original-Song

2. Aus Moises exportierter Mix mit 100% Bass, alle anderen Spuren auf 20% (inkl. Auto-Metronom, das hier gut funktioniert hat)

3. Aus Transcribe exportierter Abschnitt mit der EQ-Einstellung "Bass Select"

Mein Fazit: für meine Zwecke – Heraushören der Bass-Linien aus Songs – wirklich gut geeignet. Erstaunlich gut. Klar, Kontroll-Hören der herausgehörten Bass-Linie zum Original-Song bleibt Pflicht, aber die Isolierung des Basses aus dem Song heraus funktioniert sehr oft sehr gut. Jedenfalls bin ich drauf und dran, meinen altbewährten Workflow zu ändern und von Transcribe zu Moises als meinem Haupt-Tool zum Heraushören von Basslines zu wechseln … und das will schon was heißen, mit zunehmendem Alter wird man diesbezüglich eher deutlich unflexibler … sollte ich diesen Schritt gehen, werde ich auf die Premium-Version upgraden und hier noch mal ein Update geben, ob und für wen sich das Upgrade lohnt und was ich sonst noch für Erfahrungen mit dem Teil gemacht habe. Der Sänger unserer Coverband nutzt Moises ebenfalls und ist komplett von der Leistungsfähigkeit der KI überzeugt. Und da wir noch an das Thema „Satzgesang“ bei den Queen-Songs rangehen müssen, könnte die Premium-Variante (mit Isolierung des Background-Gesangs) genau der richtige Weg für mich sein.

Kurz zu meinem Hintergrund: ich habe in den 1980er-Jahren mit dem Bassen angefangen, es aber wegen Ausbildung, Studium, Beruf und Familie lange Zeit vernachlässigen müssen. Seit 2014 bin ich wieder regelmäßig am Start und habe seitdem in mehreren Bands gespielt, größtenteils Cover. Zur Notation verwende ich GuitarPro, zum Heraushören Transcribe. Dieses Programm bietet u.a. einen EQ mit Presets, mit denen sich z.B. die Bass-Frequenzen extrem betonen lassen, um die vom Bass gespielten Noten heraushören zu können. Das funktionierte bei mir bei den meisten Titeln so gut, dass ich mir damit von über 300 Songs die Basslinien herausgearbeitet habe. Bei manchen Titeln war’s schwieriger, so dass ich aufmerksam wurde, als mir Moises über den Weg lief, denn über jede Verbesserung des Workflows (oder Beschleunigung des Prozesses) bin ich dankbar. Ich möchte vor allem Bass spielen und nicht nur Bass heraushören.

Nun aber zur App:

Die Entwickler nehmen für sich in Anspruch, vorhandene Musik-Song-Dateien mittels KI in einzelne Instrumenten-Tracks aufteilen zu können, so dass ein Mit-Jammen zum Track (unter Ausblendung des eigenen Instruments) sowie ein genaues Heraushören des einzelnen Instruments zur eigenen Transkription möglich sein soll.

Die App gibt es sowohl für Desktop-PC als auch für Mobilgeräte (Android und Apple). Man kann mit einer Gratisversion starten, es gibt zusätzlich eine Premium- („Voller Zugang für den ernsthaften Musiker“) sowie eine Pro-Version („Fortgeschrittene KI-Tools für die Musikproduktion“), die sich jeweils im Leistungsumfang unterscheiden. So weist die Gratis-Version bereits die Kernfunktionalität (Aufteilen eines Tracks in einzelne Instrumente) auf, jedoch ist dies auf fünf Tracks im Monat beschränkt; außerdem ist die Aufteilung nur in Gesang, Schlagzeug und Bass möglich, weitere Instrumente-Einzel-Tracks für Gitarre, Hintergrundgesang, Klavier und Streicher gibt’s erst ab der Premium-Version, die monatlich 6,99 € oder 50 € im Jahr kostet. Des Weiteren bestehen bei der Gratis-Version Einschränkungen, was die Änderung von Tonhöhe, Tempo etc. angeht, dazu aber im Praxis-Teil mehr. Die recht neue „Pro“-Variante habe ich mir nicht genauer angeschaut; sie kostet 34,99 € im Monat und ist „professioneller“ aufgezogen. Auf der Moises-Webseite gibt es auch einen Vergleich des Funktionsumfangs der jeweiligen Version.

Im Folgenden beschreibe ich die Funktionalität der Gratis-Version anhand eines Beispiels, das ich für mein aktuelles Projekt (Queen-Cover) verwende. Es handelt sich dabei um den Titel „Was It All Worth It“ vom Queen-Album „The Miracle“ aus dem Jahr 1989. Alle Beschreibungen und Screenshots beziehen sich dabei auf die Desktop-PC-Version.

Beim Start des Programms stellt sich die Startseite wie folgt dar:

(Einige der Funktionalitäten in der linken Liste sind den Bezahlt-Versionen vorbehalten)

Es erscheint zunächst die Liste der bisher bearbeiteten Tracks. Mit „+ Neu“ wird ein neuer Track hinzugefügt:

Da ich die ganzen Songs auf einer Festplatte habe, kommt eine lokale Datei dazu.

OBACHT: in der Gratis-Version dürfen die Tracks nur maximal fünf Minuten lang sein. Der Rest wird einfach abgeschnitten … im vorliegenden Fall habe ich mir damit geholfen, das fast 40-sekündige Intro des Songs mit einem anderen Programm zu entfernen, zu speichern und neu hochzuladen, dann passte es schon fast.

Ist der Track hochgeladen, erscheint die Auswahl, in wie viele Teile der Track gesplittet werden soll:

Auch hier kann man die eingeschränkte Funktionalität der Gratis-Version daran erkennen, dass viele Optionen grau hinterlegt bzw. mit einem Schloss gekennzeichnet sind. Mit „Absenden“ wird der „Auftrag“ erteilt, den Song aufzusplitten:

Nach nicht allzu langer Zeit erscheint schließlich das Ergebnis:

Beim Klick auf den neuen Song dauert die Verarbeitung dann nochmal einige Sekunden, und man hat das Ergebnis des KI-Einsatzes auf dem Bildschirm:

Hier hat man nun u.a. die Möglichkeit, die einzelnen Spuren unterschiedlich laut anzuhören, im Panorama einzuordnen oder auch auf Solo bzw. Mute zu stellen. Die „Auto-Metronom“-Funktion macht genau dies: sie fügt ein Metronom hinzu … wobei mir diese Funktion nicht 100%-ig gefallen hat, bei Songs mit einem synkopierten Rhythmus (Betonung eben NICHT genau auf der EINS) wird’s etwas komisch, was aber durchaus in der Natur der Sache liegt. Von daher macht es mir nichts aus, dass das Metronom in der Gratis-Version nur für eine Minute vorgesehen ist …

Auch die übrigen Funktionen auf diesem Bildschirm sind z.T. nur eingeschränkt verfügbar:

Schaltflächen oben:

- „4 Tonspuren“: hier könnte man auch die anderen Varianten der Aufsplittung auswählen, wenn sie denn verfügbar wären …

- Bei der Auswahlliste mit dem Metronom kann das Tempo geändert werden, allerdings nur +/- 10 bpm

- Bei dem daneben stehenden Noten-Symbol kann die Tonhöhe geändert werden, in der Gratis-Version +/- 1 Halbton

- Die daneben stehende Schaltfläche dient zur Vorgabe des Einzählens, habe ich allerdings noch nie verwendet …

Die Schaltflächen unten greifen auf Beta-Versionen zurück und sind in der Gratis-Version nur eingeschränkt nutzbar:

- „Liedtext“: hier will die KI den Songtext erkennen und transkribieren. Ich hab’s nicht ausprobiert, und wenn ich an die automatisierten Untertitel von Youtube und Co. Denke, erwarte ich mir nicht allzu viel davon …

- „Akkorde“: die automatisierte Akkorderkennung kann in drei Genauigkeitsstufen eingestellt werden und funktioniert gar nicht mal so übel …

- „Abschnitte“: konnte ich auf Grund der Einschränkung der Gratis-Version nicht wirklich testen – die KI soll hier selbständig den Song in Abschnitte aufteilen können.

Soweit zur Funktionalität. Bleibt die Frage: funktioniert das Ganze auch tatsächlich? Um die Antwort vorwegzunehmen: in vielen Fällen erstaunlich gut! Klar, es gibt an manchen Stellen Aussetzer, wenn das gewählte Instrument außerhalb seines „normalen“ Frequenzbereiches spielt (wenn z.B der Bass unvermittelt eine Oktave höher spielt) oder „Übersprecher“, wenn sich Gitarre und Gesang frequenz- und soundmäßig sehr nahe beieinander sind, aber im Großen und Ganzen bin ich positiv überrascht, wie sauber – in meinem Fall – das Bass-Signal herausgefiltert wird. Das erleichtert mir die Arbeit des Heraushörens und Transkribierens ein gutes Stück, und genau das war mein Ziel. Bei der Arbeit mit einem EQ (wie bei Transcribe) beispielsweise stehen Bass und Kick bzw. Bass-Drum oft im selben Frequenzbereich in Konkurrenz miteinander, so dass das Heraushören der Bass-Linie alleine öfters schwierig ist.

Im Folgenden noch Hörbeispiele des bearbeiteten Songs (der Ausschnitt enthält jeweils 2. Intro, 1. Strophe, 1. Refrain):

1. Original-Song

2. Aus Moises exportierter Mix mit 100% Bass, alle anderen Spuren auf 20% (inkl. Auto-Metronom, das hier gut funktioniert hat)

3. Aus Transcribe exportierter Abschnitt mit der EQ-Einstellung "Bass Select"

Mein Fazit: für meine Zwecke – Heraushören der Bass-Linien aus Songs – wirklich gut geeignet. Erstaunlich gut. Klar, Kontroll-Hören der herausgehörten Bass-Linie zum Original-Song bleibt Pflicht, aber die Isolierung des Basses aus dem Song heraus funktioniert sehr oft sehr gut. Jedenfalls bin ich drauf und dran, meinen altbewährten Workflow zu ändern und von Transcribe zu Moises als meinem Haupt-Tool zum Heraushören von Basslines zu wechseln … und das will schon was heißen, mit zunehmendem Alter wird man diesbezüglich eher deutlich unflexibler … sollte ich diesen Schritt gehen, werde ich auf die Premium-Version upgraden und hier noch mal ein Update geben, ob und für wen sich das Upgrade lohnt und was ich sonst noch für Erfahrungen mit dem Teil gemacht habe. Der Sänger unserer Coverband nutzt Moises ebenfalls und ist komplett von der Leistungsfähigkeit der KI überzeugt. Und da wir noch an das Thema „Satzgesang“ bei den Queen-Songs rangehen müssen, könnte die Premium-Variante (mit Isolierung des Background-Gesangs) genau der richtige Weg für mich sein.

Grund: MP3 eingebunden

Zuletzt bearbeitet von einem Moderator:

. Na ja, erstes Review, da musste ja was schiefgehen ...

. Na ja, erstes Review, da musste ja was schiefgehen ... ich lade einen Song in die Software hoch und erhalte dafür die TABS der Gitarre?

ich lade einen Song in die Software hoch und erhalte dafür die TABS der Gitarre?